Bạn nghĩ rằng chỉ một câu hỏi gửi tới ChatGPT không gây tác động gì tới môi trường? Thực tế, mỗi truy vấn ChatGPT có thể tiêu thụ điện năng gấp 10 lần so với một lượt tìm kiếm Google. Cùng CentriX khám phá sự thật và cách giảm dấu chân năng lượng từ AI ngay hôm nay.

Vì sao cần quan tâm đến mức tiêu thụ điện của ChatGPT?

Trong kỷ nguyên số, chúng ta ngày càng dựa vào các công cụ AI như ChatGPT để giải quyết công việc, học tập và thậm chí là giải trí. Nhưng ít ai biết rằng, mỗi truy vấn mà bạn gửi đi không chỉ là văn bản đơn giản, mà còn kéo theo một chuỗi xử lý phức tạp tại các trung tâm dữ liệu công suất cao trên toàn cầu.

Mối liên hệ giữa AI và biến đổi khí hậu

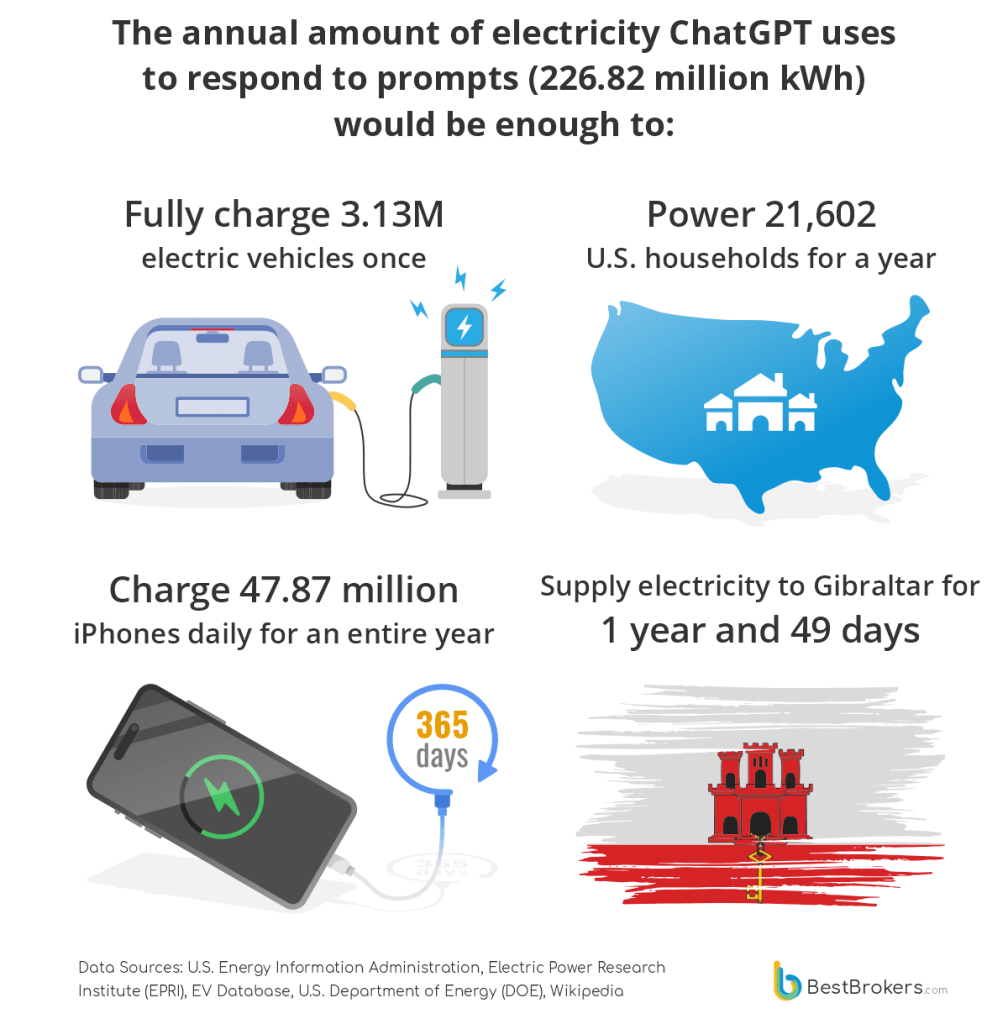

Càng nhiều người sử dụng AI, nhu cầu về tính toán càng cao, đồng nghĩa với việc lượng điện tiêu thụ cũng tăng lên. Theo ước tính của OpenAI, với 1 tỷ truy vấn mỗi ngày, hệ thống có thể tiêu tốn tới 12.5 megawatt điện năng/ngày — tương đương với mức tiêu thụ điện của hơn 10.000 hộ gia đình tại Mỹ.

Những hiểu lầm phổ biến về mức tiêu thụ của ChatGPT

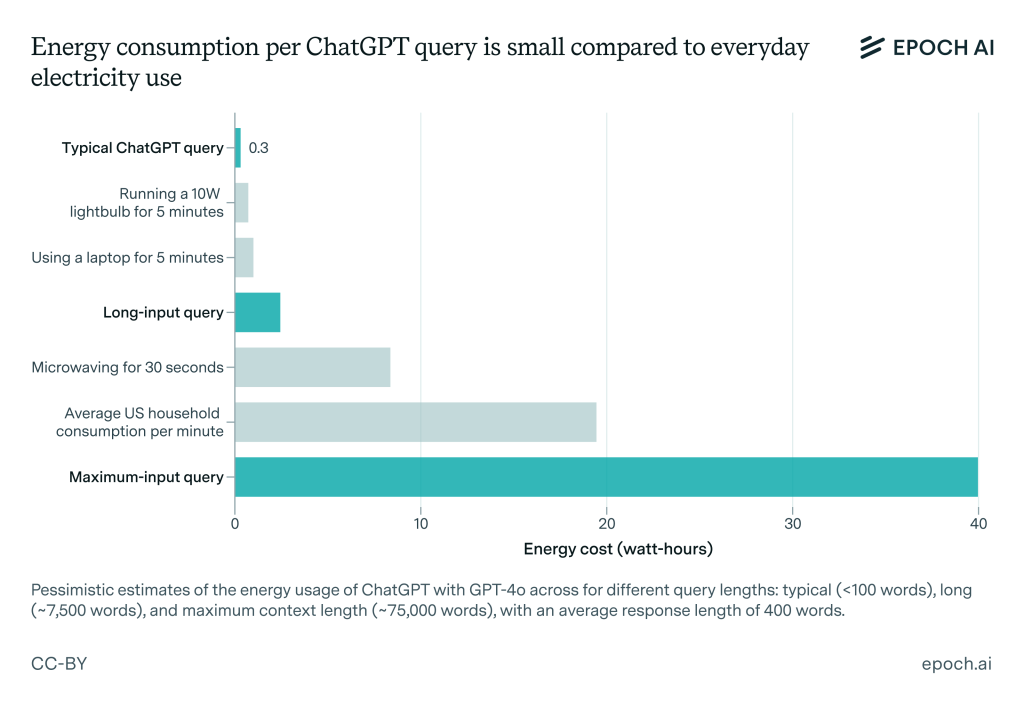

Một số nguồn từng cho rằng mỗi truy vấn ChatGPT tiêu tốn tới 3 watt-giờ (Wh), nhưng theo nghiên cứu mới nhất của Josh You từ Gradient Update (2025), con số thực tế chỉ khoảng 0.3 Wh – thấp hơn 10 lần so với dự đoán trước đó.

Con số thực tế: Một truy vấn ChatGPT tiêu tốn bao nhiêu watt-giờ?

So sánh giữa 3 Wh và 0.3 Wh: Sự thật là gì?

Khác với ước tính ban đầu từ năm 2023, các mô hình hiện đại như GPT-4o ngày nay sử dụng phần cứng tiên tiến hơn như GPU NVIDIA H100, giúp tối ưu hoá năng lượng. Với hiệu suất thực tế khoảng 10%, mỗi truy vấn trung bình (khoảng 500 token) chỉ tốn khoảng 0.3 Wh.

Để dễ hình dung: 0.3 Wh tương đương với điện năng mà một bóng đèn LED 10W tiêu thụ trong khoảng 2 phút.

Phân tích FLOP và tham số hoạt động trong GPT-4o

Mỗi token được sinh ra bởi mô hình AI yêu cầu khoảng 200 tỷ FLOP (floating-point operations). Với 500 token, hệ thống cần thực hiện khoảng 1e14 FLOP.

GPT-4o được ước tính có khoảng 400 tỷ tham số, nhưng chỉ 100 tỷ tham số hoạt động nhờ vào kiến trúc “mixture of experts” (MoE) giúp tiết kiệm tài nguyên.

Thời gian xử lý và điện năng tiêu thụ bởi GPU H100

- Công suất tiêu thụ tối đa của H100: 1500W

- Thời gian cần thiết để xử lý 1 truy vấn: 1 giây (với hiệu suất 10%)

- Điện năng tiêu tốn: 1500W * 1s * 70% (hiệu suất sử dụng điện trung bình) ≈ 0.3 Wh

Bài toán sử dụng thực tế: Từ 500 token tới 100k token

Nếu truy vấn bao gồm lượng input cực lớn (ví dụ tài liệu PDF 100k token), năng lượng tiêu thụ có thể lên tới 40 Wh/truy vấn, gấp 133 lần so với truy vấn bình thường.

Xem thêm: Tài khoản ChatGPT Plus dùng chung

Tiêu thụ nước và tác động môi trường mở rộng

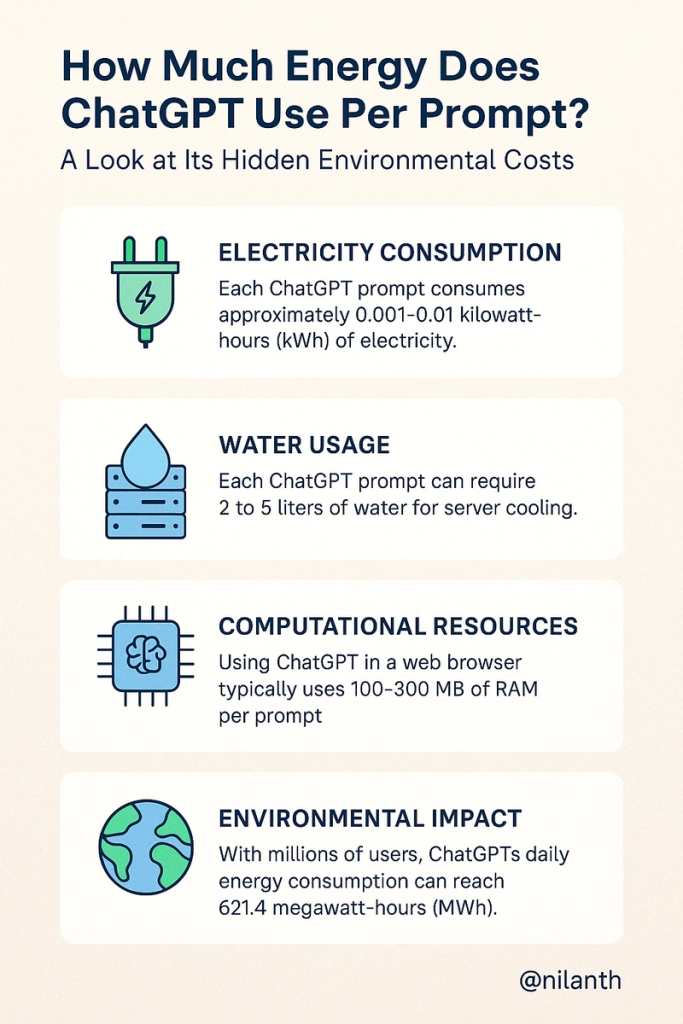

Hệ thống làm mát và nước sử dụng cho mỗi truy vấn

Các trung tâm dữ liệu sử dụng hệ thống làm mát bằng nước, và theo báo cáo từ University of California Riverside (2023), mỗi truy vấn ChatGPT có thể dùng từ 2 đến 5 lít nước để làm mát hệ thống. Với hàng tỷ truy vấn mỗi ngày, đây là mức tiêu thụ nước khổng lồ mà ít ai ngờ tới.

Đọc thêm về tác động của AI lên nguồn nước tại đây

Tổng quan chi phí môi trường ở quy mô hàng trăm triệu lượt dùng mỗi ngày

- Điện năng toàn cầu/ngày: ~621 MWh

- Tương đương lượng điện tiêu thụ hàng ngày của thành phố 60.000 dân

- Nước làm mát/ngày: khoảng 2 – 5 tỷ lít

So sánh giữa các mô hình: GPT-4o, o1, o3-mini, Claude, Gemini

Mô hình lớn hơn có tiêu thụ năng lượng nhiều hơn không?

Không hẳn. Mặc dù Claude 3.5 Sonnet có tới 400 tỷ tham số, nhưng nhờ tối ưu phần mềm và phần cứng, mức tiêu thụ có thể tương đương hoặc thấp hơn mô hình nhỏ không tối ưu.

Hiệu suất tiêu thụ giữa các GPU: A100 vs H100 vs Blackwell

- A100 (2021): tiêu thụ ~800W, hiệu suất thấp hơn

- H100 (2023): ~1500W nhưng hiệu suất gấp nhiều lần

- Blackwell (dự kiến 2025): hứa hẹn tiêu thụ ít điện hơn 30%

Tại sao o1 và o3-mini có thể gây tốn điện hơn?

Các mô hình như o1 reasoning hoặc o3-mini thường sinh ra gấp 2.5 lần số token so với GPT-4o, đồng nghĩa năng lượng tiêu tốn cũng tăng tương ứng.

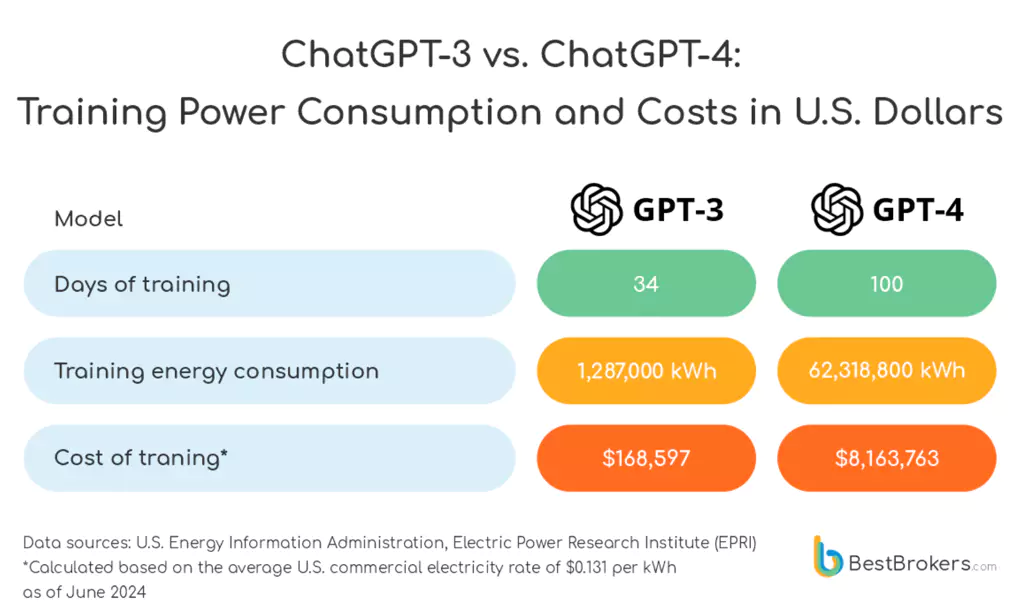

Chi phí ẩn: Huấn luyện mô hình và sản xuất GPU

Huấn luyện GPT-4o tốn bao nhiêu điện và CO2?

Một đợt huấn luyện kéo dài 3 tháng của GPT-4o ước tính tiêu thụ tới 25 megawatt điện, tương đương 20.000 hộ gia đình. Tổng CO2 thải ra lên đến 24.7 tấn – theo nghiên cứu của Luccioni et al. (2022).

Chi phí năng lượng để sản xuất GPU: Có đáng lo?

Hãng sản xuất chip như TSMC tiêu thụ khoảng 24 tỷ kWh/năm, nhưng không chỉ dành cho AI. Tổng năng lượng dùng để sản xuất 1 GPU H100 được ước tính là dưới 1% so với năng lượng nó tiêu tốn trong suốt vòng đời sử dụng.

Chi phí “embodied” và “real-time” – cái nào quan trọng hơn?

- Embodied energy (năng lượng sản xuất): thấp, cố định

- Real-time energy (năng lượng khi sử dụng): cao, có thể tăng theo số lượng truy vấn

→ Điều này cho thấy việc tối ưu trong sử dụng AI quan trọng hơn cả việc lo ngại chi phí sản xuất ban đầu.

Làm sao để giảm dấu chân năng lượng khi dùng AI?

Lời khuyên dành cho người dùng cá nhân

- Gộp các câu hỏi liên quan vào cùng một truy vấn

- Không gửi những câu lệnh thử nghiệm quá dài, dư thừa

- Sử dụng vào khung giờ thấp điểm để giảm tải hệ thống

Vai trò của nhà phát triển và nhà cung cấp AI

- Áp dụng multi-token prediction và sparse attention

- Nâng cấp lên GPU hiệu suất cao hơn, tiết kiệm điện hơn

- Công bố số liệu sử dụng năng lượng để minh bạch và thúc đẩy trách nhiệm môi trường

Tổng kết: ChatGPT có thật sự tiêu tốn nhiều năng lượng không?

Tác động nhỏ trong hiện tại – nhưng sẽ lớn dần theo thời gian

Mỗi truy vấn chỉ tương đương 0.3 Wh, gần như không đáng kể nếu so với việc bật máy lạnh, sạc laptop… Tuy nhiên, khi số lượng truy vấn tăng lên hàng tỷ mỗi ngày, tổng chi phí trở thành vấn đề nghiêm trọng về môi trường.

Minh bạch dữ liệu – điều AI cần trong tương lai

Các công ty như OpenAI, Anthropic, Google nên công khai dữ liệu tiêu thụ điện, nước và CO2 để thúc đẩy sự minh bạch và nhận thức người dùng.

Bạn có thể xem toàn bộ bảng tính về mức tiêu thụ năng lượng tại Gradient Updates Source Sheet.

Câu hỏi thường gặp (FAQ)

ChatGPT có tốn điện hơn Google không?

Đúng. Một truy vấn ChatGPT hiện nay tiêu tốn điện gấp 10 – 15 lần so với một lượt tìm kiếm Google.

Có cách nào sử dụng AI thân thiện với môi trường hơn không?

- Sử dụng các mô hình nhẹ như GPT-4o mini

- Tránh sử dụng mô hình reasoning không cần thiết như o1

- Giới hạn input lớn nếu không cần thiết

ChatGPT có tiêu tốn điện khi không sử dụng không?

Không. Mô hình chỉ tiêu tốn điện trong thời gian xử lý truy vấn. Tuy nhiên, hệ thống trung tâm dữ liệu vẫn phải duy trì hoạt động liên tục để đảm bảo độ trễ thấp.

xem thêm: 10+ cách marketer sử dụng chatgpt